|

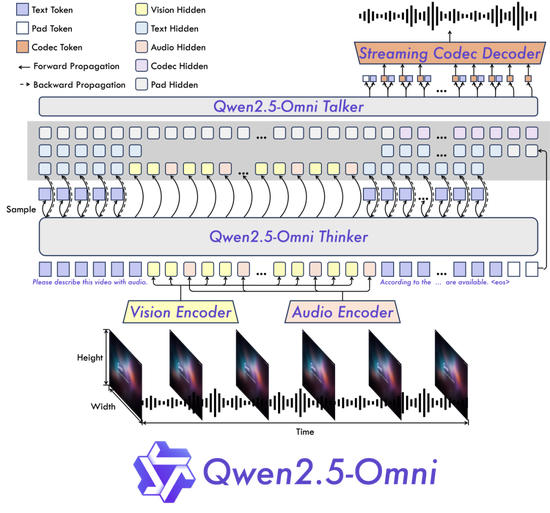

起首:通义千问Qwen 今天,咱们发布了 Qwen2.5-Omni,Qwen 模子家眷中新一代端到端多模态旗舰模子。该模子专为全目的多模态感知设想,概况无缝贬责文本、图像、音频和视频等多种输入模样,并通过及时流式反映同期生成文本与当然语音合成输出。 该模子现已在 Hugging Face、ModelScope、DashScope 和 GitHub上开源绽开,你不错通过咱们的Demo体验互动功能,或是通过Qwen Chat 告成发起语音或视频聊天,千里浸式体验全新的 Qwen2.5-Omni 模子浩繁性能。 主要特色 万能变嫌架构:咱们建议了一种全新的Thinker-Talker架构,这是一种端到端的多模态模子,旨在守旧文本/图像/音频/视频的跨模态意会,同期以流式形式生成文本和当然语音反映。咱们建议了一种新的位置编码时刻,称为TMRoPE(Time-aligned Multimodal RoPE),通过期刻轴对都完毕视频与音频输入的精确同步。 及时音视频交互:架构旨在守旧所有及时交互,守旧分块输入和即时输出。 当然灵通的语音生成:在语音生成的当然性和矫健性方面超过了很多现存的流式和非流式替代有打算。 全模态性能上风:在同等鸿沟的单模态模子进行基准测试时,推崇出异常的性能。Qwen2.5-Omni在音频才调上优于同样大小的Qwen2-Audio,并与Qwen2.5-VL-7B保捏同等水平。 异常的端到端语音请示跟从才调:Qwen2.5-Omni在端到端语音请示跟从方面推崇出与文本输入贬责相失色的效率,在MMLU通用常识意会和GSM8K数学推理等基准测试中推崇优异。 Qwen2.5-Omni-7B demo 模子架构 Qwen2.5-Omni遴荐Thinker-Talker双核架构。Thinker 模块如同大脑,认真贬责文本、音频、视频等多模态输入,生成高层语义表征及对应文本本色;Talker 模块则同样发声器官,以流式形式接管 Thinker及时输出的语义表征与文本,灵通合成闹翻语音单位。Thinker 基于 Transformer 解码器架构,和会音频/图像编码器进行特征提真金不怕火;Talker则遴荐双轨自总结 Transformer 解码器设想,在考验和推理经过中告成接管来自 Thinker 的高维表征,并分享一都历史高下文信息,变成端到端的息争模子架构。

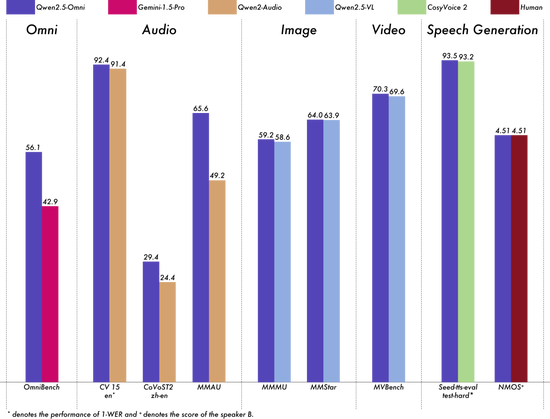

模子架构图 模子性能 Qwen2.5-Omni在包括图像,音频,音视频等多样模态下的推崇都优于同样大小的单模态模子以及阻滞源模子,举例Qwen2.5-VL-7B、Qwen2-Audio和Gemini-1.5-pro。 在多模态任务OmniBench,Qwen2.5-Omni达到了SOTA的推崇。此外,在单模态任务中,Qwen2.5-Omni在多个领域中推崇优异,包括语音识别(Common Voice)、翻译(CoVoST2)、音频意会(MMAU)、图像推理(MMMU、MMStar)、视频意会(MVBench)以及语音生成(Seed-tts-eval和主不雅当然听感)。

模子性能图 下一步 咱们期待听到您的反馈,并看到您使用 Qwen2.5-Omni 树立的变嫌期骗。在不久的改日,咱们将效率增强模子对语音请示的罢黜才调,并栽植音视频协答应会才调。更值得期待的是,咱们将捏续拓展多模态才调鸿沟,以发展成为一个全面的通用模子! 体验形式 Qwen Chat:https://chat.qwenlm.ai Hugging Face:https://huggingface.co/Qwen/Qwen2.5-Omni-7B ModelScope:https://modelscope.cn/models/Qwen/Qwen2.5-Omni-7B DashScope:https://help.aliyun.com/zh/model-studio/user-guide/qwen-omni GitHub:https://github.com/QwenLM/Qwen2.5-Omni Demo体验:https://modelscope.cn/studios/Qwen/Qwen2.5-Omni-Demo 👇点击‘阅读原文’一键体验全模态及时互动  海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

包袱裁剪:李桐 |